PyTorch Tensor和tensor区别

玄云飘风 人气:0Tensor和tensor的区别

本文列举的框架源码基于PyTorch1.0,交互语句在0.4.1上测试通过

import torch

在PyTorch中,Tensor和tensor都能用于生成新的张量:

>>> a=torch.Tensor([1,2]) >>> a tensor([1., 2.]) >>> a=torch.tensor([1,2]) >>> a tensor([1, 2])

但是这二者的用法有什么区别呢?我没有找到合适的中文资料,英文的资料如 https://discuss.pytorch.org/t/what-is-the-difference-between-tensor-and-tensor-is-tensor-going-to-be-deprecated-in-the-future/17134/8 也已经过时了,那就自己动手丰衣足食吧。

首先,我们需要明确一下,torch.Tensor()是python类,更明确地说,是默认张量类型torch.FloatTensor()的别名,torch.Tensor([1,2])会调用Tensor类的构造函数__init__,生成单精度浮点类型的张量。

>>> a=torch.Tensor([1,2]) >>> a.type() 'torch.FloatTensor'

而torch.tensor()仅仅是python函数:http://pytorch.org/docs/stable/torch.html#torch.tensor ,函数原型是:

torch.tensor(data, dtype=None, device=None, requires_grad=False)

其中data可以是:list, tuple, NumPy ndarray, scalar和其他类型。

torch.tensor会从data中的数据部分做拷贝(而不是直接引用),根据原始数据类型生成相应的torch.LongTensor、torch.FloatTensor和torch.DoubleTensor。

>>> a=torch.tensor([1,2]) >>> a.type() 'torch.LongTensor'

>>> a=torch.tensor([1.,2.]) >>> a.type() 'torch.FloatTensor'

>>> a=np.zeros(2,dtype=np.float64) >>> a=torch.tensor(a) >>> a.type() 'torch.DoubleTensor'

这里再说一下torch.empty(),根据 http://pytorch.org/docs/stable/torch.html?highlight=empty#torch.empty ,我们可以生成指定类型、指定设备以及其他参数的张量,由于torch.Tensor()只能指定数据类型为torch.float,所以torch.Tensor()可以看做torch.empty()的一个特殊情况。

最后放一个小彩蛋

>>> a=torch.tensor(1) >>> a tensor(1) >>> a.type() 'torch.LongTensor' >>> a=torch.Tensor(1) >>> a tensor([0.]) >>> a.type() 'torch.FloatTensor'

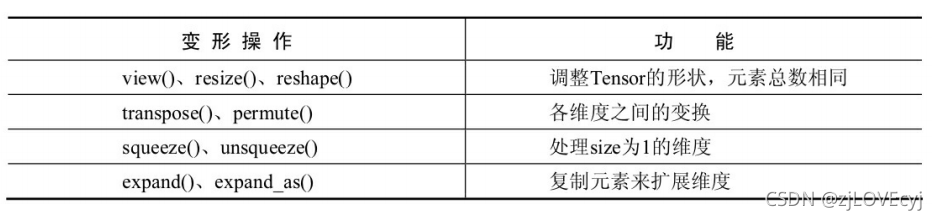

pytorch Tensor变形函数

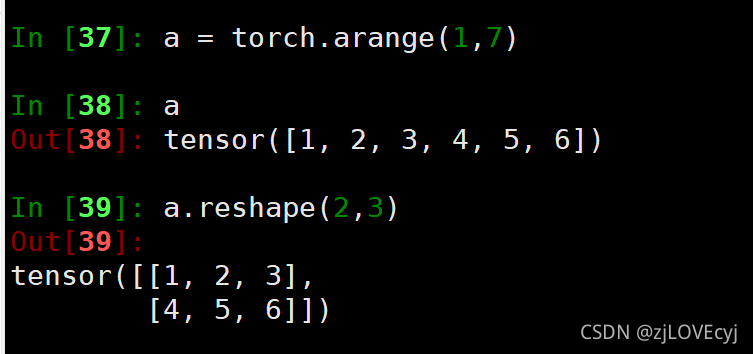

view(), resize(), reshape() 在不改变原tensor数据的情况下修改tensor的形状,前后要求元素总数一致,且前后tensor共享内存

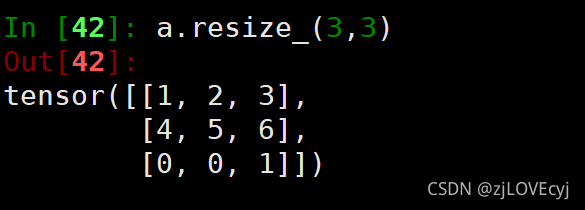

如果想要直接改变Tensor的尺寸,可以使用resize_()的原地操作函数。

在resize_()函数中,如果超过了原Tensor的大小则重新分配内存,多出部分置0,如果小于原Tensor大小则剩余的部分仍然会隐藏保留。

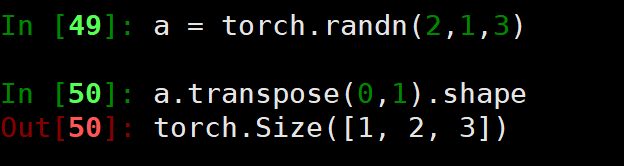

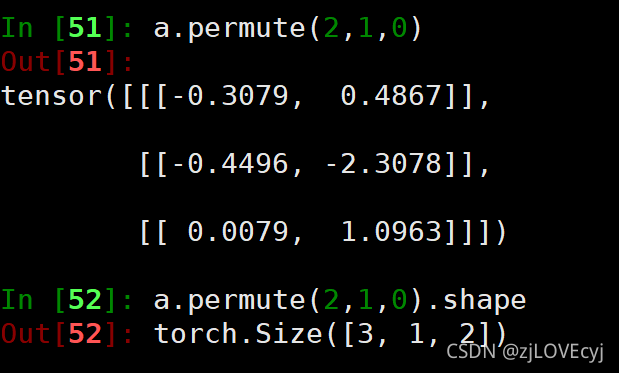

transpose()函数可以将指定的两个维度的元素进行转置,而permute()函数则可以按照给定的维度进行维度变换。

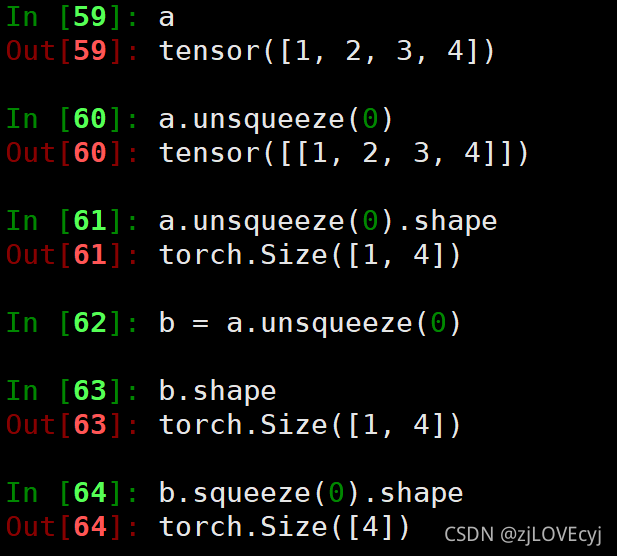

在实际的应用中,经常需要增加或减少Tensor的维度,尤其是维度为1的情况,这时候可以使用squeeze()与unsqueeze()函数,前者用于去除size为1的维度,而后者则是将指定的维度的size变为1。

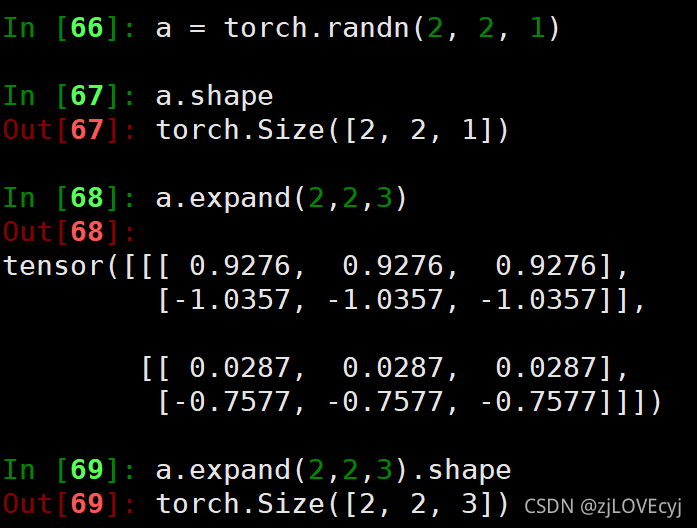

有时需要采用复制元素的形式来扩展Tensor的维度,这时expand就派上用场了。

expand()函数将size为1的维度复制扩展为指定大小,也可以使用expand_as()函数指定为示例Tensor的维度。

注意:在进行Tensor操作时,有些操作如transpose()、permute()等可能会把Tensor在内存中变得不连续,而有些操作如view()等是需要Tensor内存连续的,这种情况下需要使用contiguous()操作先将内存变为连续的。在PyTorch v0.4版本中增加了reshape()操作,可以看做是Tensor.contiguous().view()

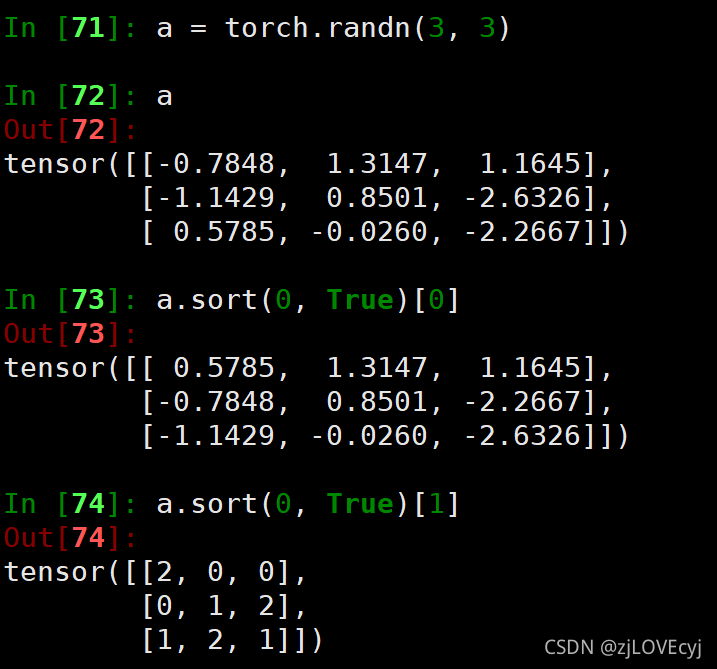

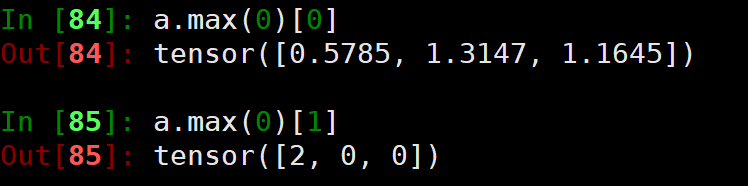

Tensor的排序与取极值

排序函数sort(),选择沿着指定维度进行排序,返回排序后的Tensor及对应的索引位置。max()与min()函数则是沿着指定维度选择最大与最小元素,返回该元素及对应的索引位置。

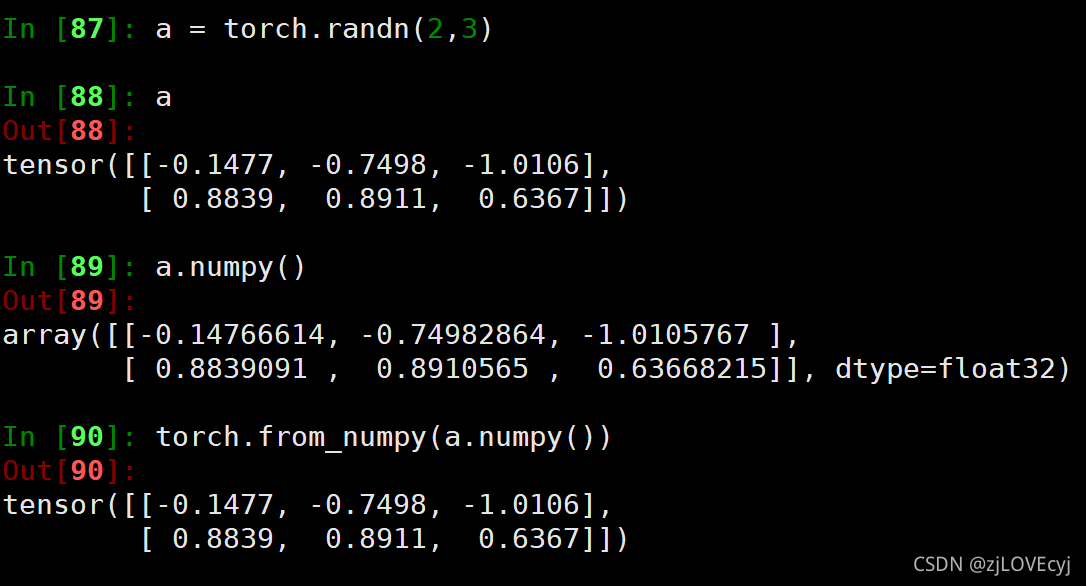

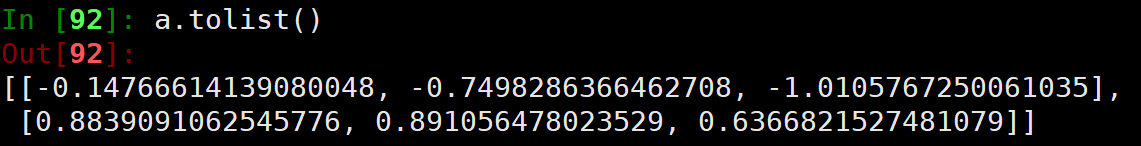

Tensor与NumPy转换

Tensor与NumPy可以高效地进行转换,并且转换前后的变量共享内存。在进行PyTorch不支持的操作时,甚至可以曲线救国,将Tensor转换为NumPy类型,操作后再转为Tensor。

以上为个人经验,希望能给大家一个参考,也希望大家多多支持。

加载全部内容