linux ceph安装

水&滴 人气:2前言

k8s集群使用什么样的存储比较好那,我调研了一下分布式存储ceph,在这里分享给大家。

一、基础环境

1、服务分布情况

Node1: admin,osd,mon

Node2: osd,mds, client

2、 网络配置 (所有节点)

修改主机名, 切记主机名不能出现下划线 修改主机名(/etc/hostname): hostnamectl set-hostname node1 hostnamectl set-hostname node2 修改 /etc/hosts 加入 vim /etc/hosts 192.168.84.131 node1 192.168.84.132 node2

3、SSH免密访问 (所有节点)

ssh-keygen ssh-copy-id -i id_rsa.pub root@192.168.84.131

二、安装

1、将新挂载的硬盘格式化,作为osd的存储(有osd节点的都要做)

mkfs.xfs /dev/sdb blkid /dev/sdb mkdir -p /data/osd vim /etc/fstab UUID="57493ebb-6744-4355-a7f6-ec7538b4b65e" /data/osd xfs defaults 0 0 mount -a

2、在管理节点node1安装ceph-deploy管理工具

(1)配置yum源

vim /etc/yum.repos.d/ceph.repo [ceph] name=ceph baseurl=http://mirrors.aliyun.com/ceph/rpm-jewel/el7/x86_64/ gpgcheck=0 priority=1 [ceph-noarch] name=cephnoarch baseurl=http://mirrors.aliyun.com/ceph/rpm-jewel/el7/noarch/ gpgcheck=0 priority=1 [ceph-source] name=Ceph source packages baseurl=http://mirrors.aliyun.com/ceph/rpm-jewel/el7/SRPMS gpgcheck=0 priority=1 #清楚yum缓存,重新加载 yum clean all yum makecache

(2)安装ceph-deploy管理工具

yum -y install ceph-deploy

(3)创建Monitor服务

mkdir /data/ceph cd /data/ceph/ ceph-deploy new node1

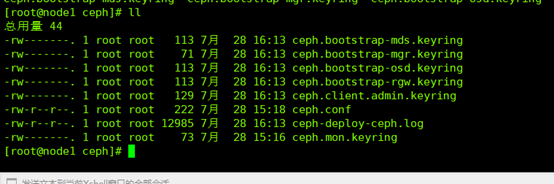

ceph.conf ceph的配置文件 ceph-deploy-ceph.log ceph日志 ceph.mon.keyring ceph monitor密钥环文件 #如果想要修改守护进程数,也就是副本数,可以在ceph.conf配置文件中添加如下行 osd_pool_default_size = 1 ##副本数

3、在所有主机上安装ceph

ceph-deploy install node1 node2 #上面这个命令是去官方服务器下载安装,相当慢一般不会这样用。之前管理节点node1配置过ceph的阿里云的源,可以直接yum安装。不过另外主机node2需要先配置yum源,再安装。 yum -y install epel-release yum -y install ceph-release yum -y install ceph ceph-radosgw

4、在管理节点上安装Monitor(监控)

cd /data/ceph/ ceph-deploy mon create node1 ceph-deploy gatherkeys node1

5、创建osd

#前面已经创建过osd目录并挂载,这里只需要创建osd节点即可。 ceph-deploy osd prepare node1:/data/osd node2:/data/osd

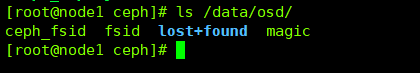

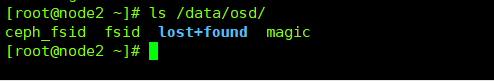

在不同的主机上可以看到,对应的节点会生成文件

6、激活osd

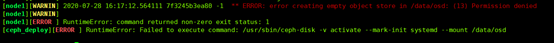

#在管理节点node1上激活各节点的osd ceph-deploy osd activate node1:/data/osd node2:/data/osd

#上图可以明显看出是权限不足的原因,直接授权777 chmod 777 -R /data/osd/ #重新执行激活 ceph-deploy osd activate node1:/data/osd node2:/data/osd

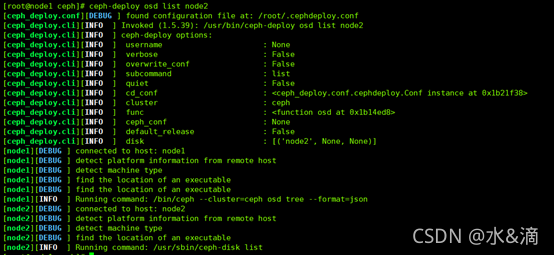

激活完成后可以使用命令查看osd

ceph-deploy osd list node1 #也可以查看多个节点,中间用空格隔开

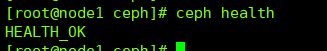

#使用命令将配置文件和admin密钥同步到各个节点,以便各个节点使用ceph命令时无需指定Monitor地址和ceph.client.admin.keyring密钥。注意:还需要修改各个节点ceph.client.admin.keyring密钥的权限 ceph-deploy admin node1 node2 node1: cd /data/ceph chmod +r ceph.client.admin.keyring node2: cd /etc/ceph chmod +r ceph.client.admin.keyring 最后查看osd状态: ceph health

7、部署mds

ceph-deploy mds create node2 ceph mds stat 查看集群状态: ceph -s

结语

集群状态当时忘记截图了,执行ceph -s 命令,大家只要看到包含“HEALTH_OK”的字样,集群就部署成功了。

加载全部内容